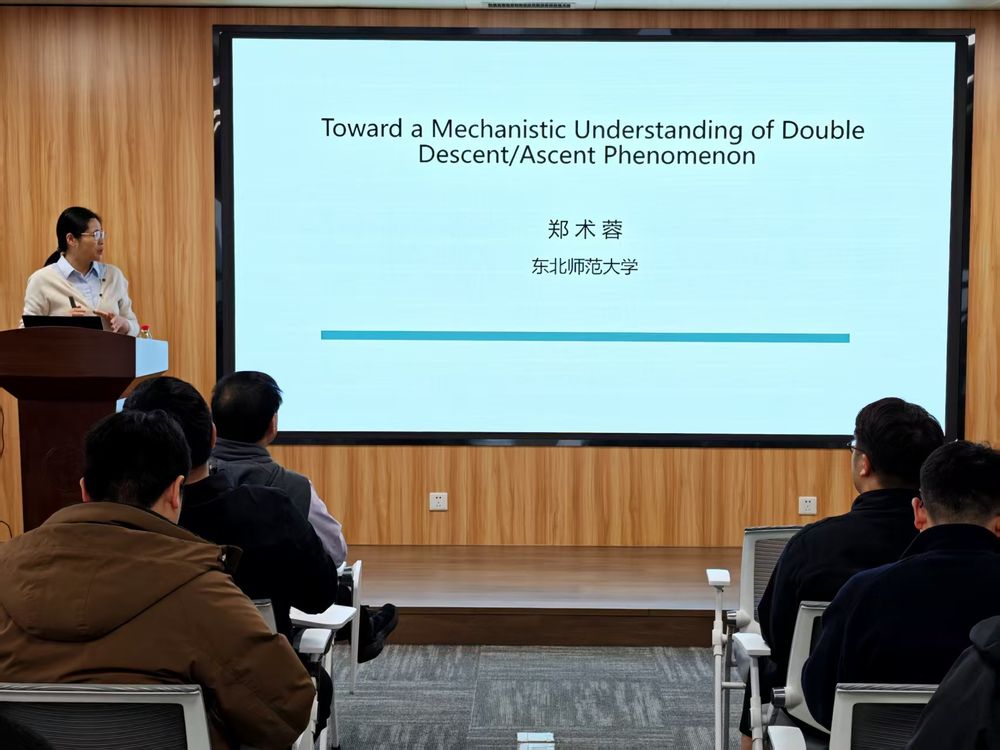

2026年4月22日,必威betway西汉姆“兰台大讲堂”迎来新一期学术分享。受学院金加顺院长邀请,东北师范大学郑术蓉教授莅临我院,为师生带来了题为“Toward a Mechanistic Understanding of Double Descent/Ascent Phenomenon”的精彩学术报告。活动吸引了众多院内外师生踊跃参会,共同探讨高维统计与机器学习交叉领域的热点问题。

面对近年来机器学习和高维统计中广泛涌现的“过参数化(Over-parameterized)”模型,传统理论认为泛化误差会遵循“偏差-方差权衡(Bias-Variance Tradeoff)”而呈现出经典的U型曲线。然而,最新研究发现,当模型复杂度足够大时,泛化误差会出现第二次下降,这便是著名的“双重下降(Double Descent)”现象。报告伊始,郑教授从线性回归、随机特征模型等经典研究切入,指出其内在统计机制是当前学界关心的课题。

针对这一前沿问题,郑教授及其合作者详细提出了一种新的机制性理解视角。通过引入均值向量的Hotelling 检验以及协方差矩阵的单位阵检验两个具体且生动的例子,郑教授详细阐述了检验统计量的渐近方差在维度p与n以不同速度收敛时的表现,从而在理论层面解释了功效函数呈现“双重上升”的机制。更进一步,为改善功效函数在过参数化状态下的病态表现,郑教授提出了一种新颖的正则化方法。最后,她展示了在正态分布及Gamma分布等多种复杂设定下的广泛模拟研究,印证了该结果。

讲座尾声的互动交流环节学术氛围浓厚,与会师生围绕正则化参数的选取、检验统计量在实际高维复杂数据中的应用边界等技术细节踊跃提问。郑教授耐心细致地解答了各项提问,极大拓宽了在场师生对统计推断与机器学习机制融合的新思考。

本次报告作为“兰台大讲堂”的又一重磅学术篇章,不仅有力促进了前沿学术思想的碰撞与交融,也为学院的学术研究注入了新的活力。通过与顶尖学者的深度对话,师生们进一步拓宽了国际化视野,对高维数据分析在现代机器学习理论中的前沿机制有了更为深刻的洞察与把握。

会议室预约

会议室预约 资料下载

资料下载